百度沈抖:文心系列主力模型免费,是为了最大限度降低企业创新试错成本

5月28日,一场关于智能经济的盛会——2024智能经济论坛,在北京隆重举行。百度集团执行副总裁、百度智能云事业群总裁沈抖,在会上深入解读了文心系列主力大模型免费的背后逻辑。更进一步的,为了推动行业大模型的广泛应用,百度智能云推出了“千帆·行业增强版”,该版本已经在政务、交通、工业等多个行业成功落地。

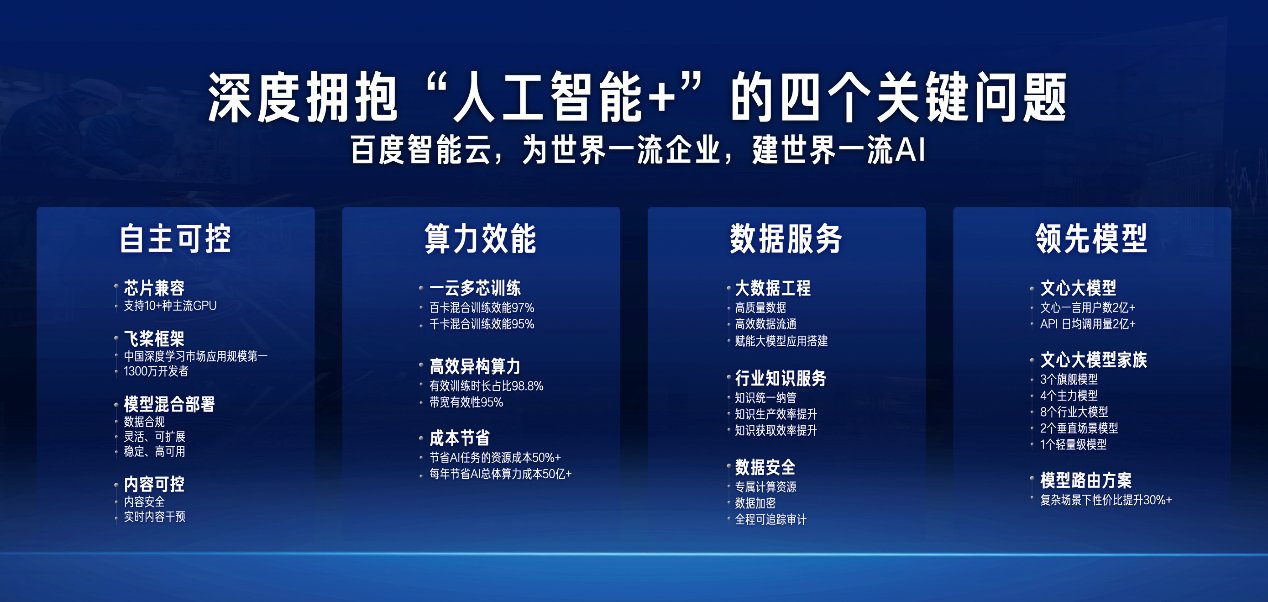

沈抖坦言,之所以能够实行免费策略,主要得益于百度强大的技术能力,特别是其高效的AI异构算力管理平台和“一云多芯”技术的支持。目前,文心大模型在中国已经实现了最大的产业落地规模,超过半数的央企正在与百度携手,共同推进AI创新。

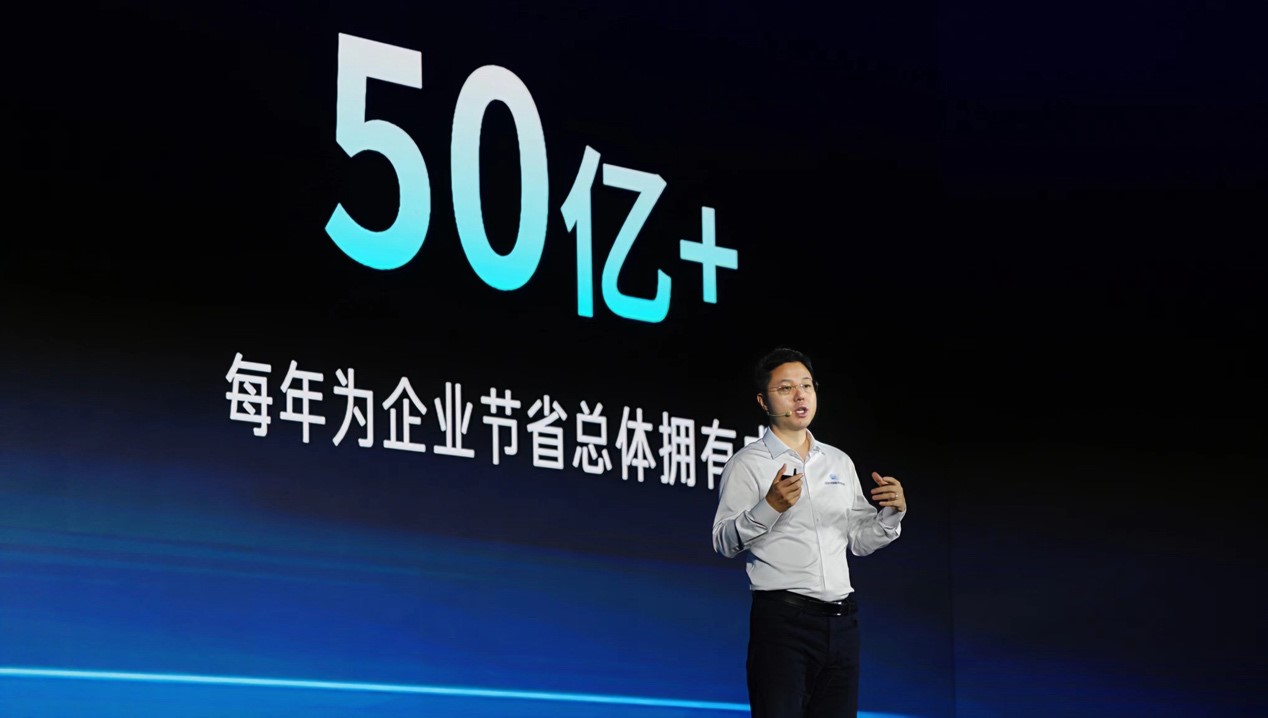

主力模型免费每年为企业节省50亿智算成本

揭秘文心系列主力模型免费的深层原因,沈抖表示:“我们希望通过免费,消除大家在价格上的顾虑,把更多精力投入到场景和应用的创新上。现在,创新的成本降低了,大家可以更大胆、更快速地尝试各种场景,快速验证想法。一旦成功,就可以迅速复制推广。”

就在一周前,百度智能云宣布了两款重要模型——ERNIE Speed和ERNIE Lite的全面免费。这两款模型在文案创作、对话交流、知识问答和内容续写等场景中有着极高的使用量。

沈抖在会上首次披露了模型免费背后的技术支撑。他强调,百度百舸·AI异构计算平台能够对分布在不同地点、规模和集群的智能算力进行统一、高效管理。通过优化芯片性能、自动选型及潮汐混部等技术,该平台显著提升了智能算力的效率,使得万卡集群上的模型有效训练时长占比超过了惊人的98.8%。相同的大模型任务,在百舸的助力下,客户能够节省一半的资源成本,据估算,每年可为企业节约的智算成本高达50亿元以上。

在“一云多芯”方面,百舸展现出了卓越的兼容性和高效性。它支持昆仑芯、昇腾、海光DCU以及英伟达、英特尔等国内外顶级AI芯片,并允许在同一智算集群中混合使用不同厂商的芯片。这一技术最大限度地屏蔽了硬件间的差异,不仅帮助企业摆脱了对单一芯片的依赖,还构建了一个更具性价比、更安全和更有弹性的供应链体系。

此外,千帆ModelBuilder通过其模型路由能力,实现了任务与模型的精准匹配。以小度AI助手为例,在模型路由的帮助下,相较于全部调用旗舰版文心大模型,其成本急剧下降了99%,同时模型响应速度也提升了2倍。沈抖指出:“即使在复杂的应用场景下,模型路由也能帮助企业节省30%的成本。”

目前,文心大模型日均调用量已突破2亿次,其每天处理的文本量相当于74万本《新华字典》,成为了中国应用最广泛的大模型。而千帆平台已累计服务了10.5万家企业用户,帮助他们精调了1.75万个大模型,并开发出了32万个AI原生应用。

“千帆行业增强版”加速行业大模型应用落地

为了加速行业大模型的应用落地,百度智能云推出了“千帆·行业增强版”。沈抖强调,行业大模型本质上是一个由通用大模型和多个行业模型组成的解决方案。然而,复杂的企业应用场景使得仅依赖孤立的行业模型解决问题变得低效且复杂。因此,“千帆·行业增强版”应运而生,它将通用大模型的各项能力与行业模型的专业性相结合,通过一系列工具和组件,支持从资源管理到大模型服务再到应用开发的全流程。

具体而言,“千帆·行业增强版”由资源服务、大模型服务和应用服务三大部分构成。它不仅提供了千帆和百舸的通用功能,还针对行业需求进行了扩展和适配。在资源服务层面,企业可以根据自身业务情况扩展多源数据治理和云边端协同等能力;在大模型服务层面,企业可以在千帆平台上自由选择和扩展各类大模型及行业智能体;在应用服务层面,则支持添加运营、运维以及应用开发等各类业务逻辑。

“千帆·行业增强版”的推出,使得应用开发范式发生了根本性变化。复杂的工程问题被千帆平台所屏蔽,真正实现了“场景驱动”的开发模式。目前,该平台已经在政务、交通、工业和金融等多个行业得到了广泛应用。

在国内大模型行业价格战的硝烟中,多位企业技术负责人表示,价格只是选择大模型的一个考量因素,模型效果和应用场景才是更为重要的决定因素。沈抖自豪地宣布,目前百度文心大模型已经在中国拥有最大的产业落地规模,超过半数的央企正在借助百度智能云的技术和服务推动AI创新。

从贵阳的交通信控系统到蔚来的智能座舱助手NOMI,再到中化信息的新型材料研发助手“化小易”,百度智能云的技术正在各个行业中发挥着巨大作用。此外,百度智能云还与上海交通大学合作构建了科研创新平台,并与沈阳首府经开区共同规划了智算中心,为当地的特色产业和重点产业提供强大的算力支持。这些成功案例充分展示了百度智能云在推动AI与大模型技术落地方面的实力和决心。